Google 近日於官方平台正式發佈新一代 AI 模型「SignGemma」,可即時將手語轉譯為文字,為聽障與失聰人士開啟無障礙數碼溝通的新可能。該模型由 DeepMind 團隊主導研發,預計於 2025 年底前正式公開,並將納入 Gemini 家族開源模型系列,供全球開發者共同應用與改進。

SignGemma 並非單純手語翻譯工具,其背後代表的,是一場關於「AI × 包容科技」的技術轉向。透過模型訓練與視覺語意解碼能力,SignGemma 有望解決過往手語翻譯精準度低、設備限制高等問題,推動語言平權與無障礙應用普及化。

目前Google已開放官網表單,邀請有興趣參與SignGemma早期測試的開發者與機構註冊,網址為:http://goo.gle/SignGemma。

手語科技與 AI 無障礙應用的交叉點

根據世界衛生組織數據,全球目前約有 4.3 億人患有中重度聽力損失,當中不少人以手語作為日常主要溝通方式。然而,社會上對手語的理解與普及程度仍有限,導致聽障人士在醫療、就業、教育等情境中,經常面對資訊阻隔與社交障礙。

在此脈絡下,Google 推出的 SignGemma 並不僅是一個語言轉譯工具,更標誌著「AI 無障礙設計」邁向多模態理解(Multimodal Understanding)的一大步。與過往依賴硬體或人力翻譯的手語科技相比,SignGemma 以純視覺辨識方式理解手部動作及臉部表情,並以自然語言即時輸出文字,有望大幅降低設備門檻,促進普及應用。

這項技術若能持續擴展語種與精準度,將對以下幾個領域帶來革命性影響:

📚 教育支援:幫助教師與學生跨越語言理解障礙

🏥 醫療溝通:減少診間資訊誤解,提升醫患互信

🏢 公共服務:自動辨識手語查詢內容,改善政府機關及企業接待流程

🟩 五大核心亮點|SignGemma 如何重新定義手語溝通?

Google 於 I/O 2025 公布的 SignGemma 模型,標誌 AI 模型正式進入「視覺語言理解」階段。此模型由 DeepMind 團隊研發,融合語言模型與圖像辨識技術,具備以下五項顯著亮點:

1️⃣ 手語即時翻譯文字

SignGemma 支援美國手語(ASL)識別,能即時將手勢、動作與臉部表情轉譯為英文文字。系統不僅辨識準確率高,更具備即時性,有望應用於會議、客服、直播等即時溝通場景。

2️⃣ 開源架構,開放應用彈性

作為 Gemini 家族的一員,SignGemma 將於年底以開源模型形式釋出。開發者可根據不同應用場景,部署至嵌入式裝置、本地伺服器或雲端平台,加快手語功能落地速度。

3️⃣ 社群共建+尊重文化差異

Google 特別邀請全球聽障社群、語言學家及開發者參與早期測試,確保模型設計符合文化語境、手語規則及真實溝通需求。這種「社群共建導向」為 AI 模型發展帶來更多共融可能。

4️⃣ 跨語種擴展潛力

雖然目前版本僅支援 ASL,但 Google 已透露計畫支援更多語種,如英國手語(BSL)、國際手語(IS)等。此舉有助建立跨國聽障溝通橋樑,提升 AI 的全球包容性。

5️⃣ 無障礙 AI 設計標準提升

SignGemma 的誕生反映 Google 對「無障礙 AI 設計」的系統性重視。配合 Android TalkBack、OCR 辨識、Face Control 等功能,Google 正逐步構建一個多元用戶皆可使用的 AI 生態系。

由 SignGemma 靈感走到商業應用實作

SignGemma 展示了 AI 模型在「語言理解 × 無障礙科技」的潛力,但這類 AI 工具並非只屬於大型科技公司。透過適當的學習與實作訓練,即使無需撰寫程式碼,你亦可以運用現有 No-Code 平台與 AI 模型,快速打造屬於自己的智能工具。

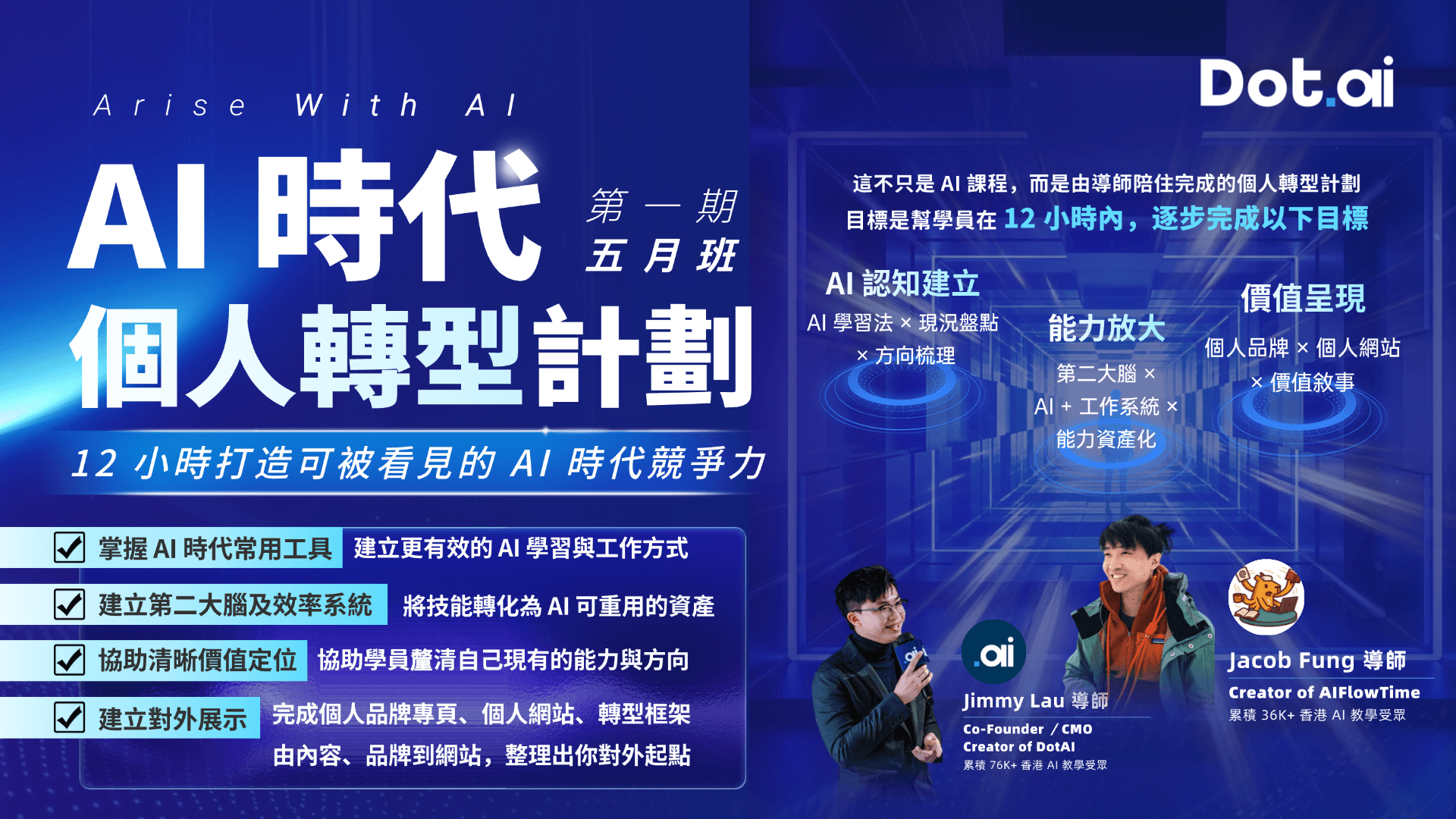

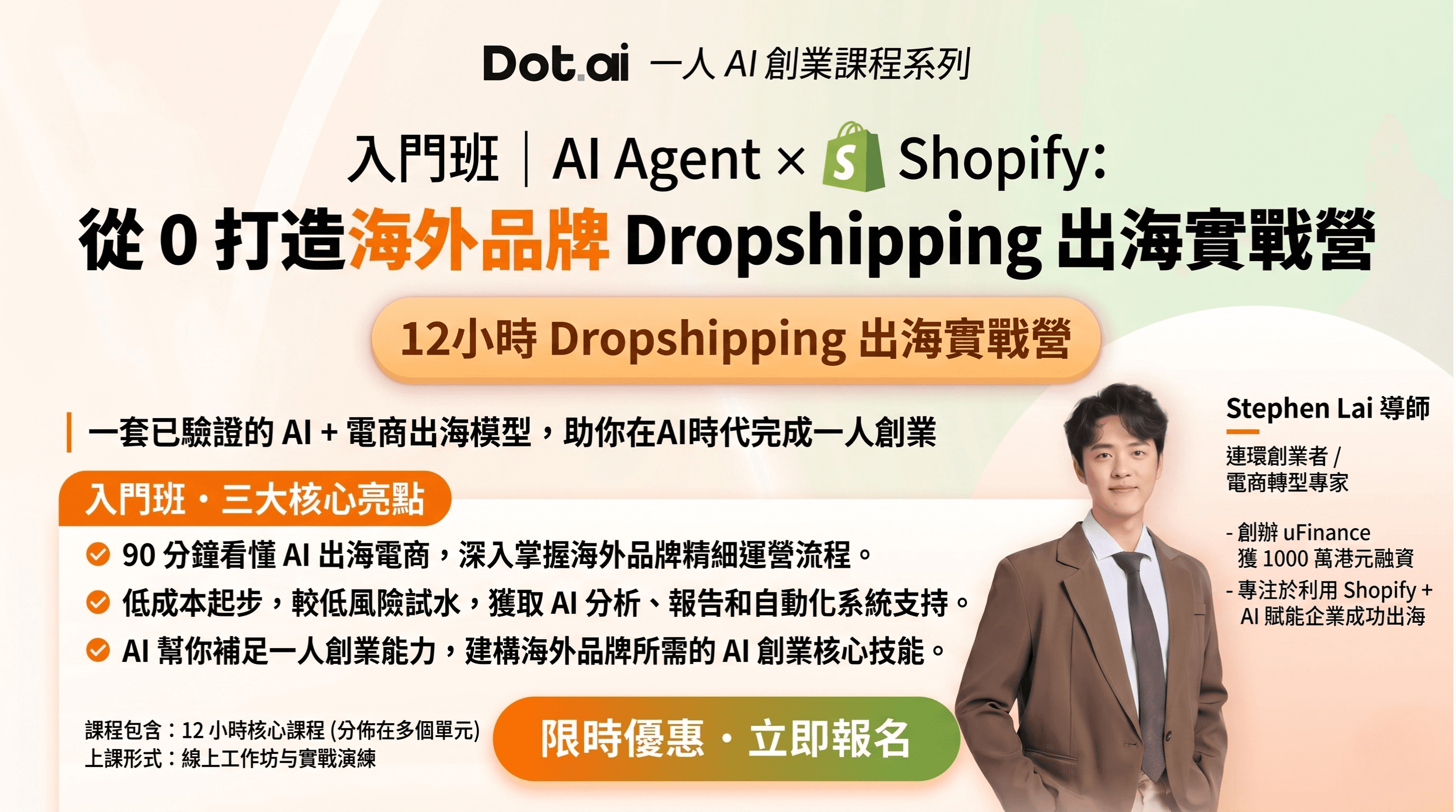

若你希望掌握相關技術,DotAI 推出的【全方位 AI Agent + No-Code 商業 AI 實戰班】正是你的最佳起點。課程設計強調「即學即用」與「商業場景導向」,透過 4 堂課(共 10 小時),帶你一步步掌握以下技能:

🛠️ 無需寫 Code,也能建立網站、App、智能助理

⚙️ 打造屬於你的 AI Agent,自動處理重複工作

💼 結合真實商業案例,立即應用於行銷、自動回覆、客戶服務等流程

📣 即刻報名【全方位 AI Agent + No-Code 實戰班】,搶先進入 AI 藍海市場!

🔗 立即了解課程詳情

DotAI Spot

AI 實戰成長社群

DotAI 全新學習體驗,陪伴您跨越 AI 學習迷惘

其他文章